Un projet IA peut être conforme techniquement… mais illégal juridiquement

Un projet d’intelligence artificielle peut fonctionner parfaitement sur le plan technique —

tout en étant non conforme au RGPD.

Dans la majorité des cas, le risque ne vient pas d’un piratage.

→ Il vient de décisions internes mal encadrées :

- partage de données trop large

- analyse juridique incomplète

- gouvernance insuffisante

- absence de contrôle sur les données sensibles

Pourquoi les projets IA augmentent les risques RGPD

Les projets IA reposent souvent sur une logique simple :

→ plus de données = meilleur modèle

Mais d’un point de vue réglementaire :

→ plus de données = plus de responsabilité

Les systèmes d’intelligence artificielle nécessitent :

- de grandes quantités de données

- des croisements multiples

- des accès étendus

Ce qui augmente fortement :

- le risque de mauvaise utilisation

- le risque de ré-identification

- l’exposition réglementaire

Le cas NHS et DeepMind (Royaume-Uni)

Entre 2016 et 2017, le National Health Service a collaboré avec DeepMind pour développer une application appelée Streams, destinée à détecter rapidement certaines pathologies graves.

Dans ce cadre, les données de 1,6 million de patients ont été transmises à DeepMind.

→ Le problème : ces données ne concernaient pas uniquement les patients ciblés par l’outil.

Elles incluaient :

- des historiques médicaux complets

- des données d’hospitalisation

- des informations de santé sensibles

y compris pour des patients sans lien direct avec l’usage de l’application.

Pourquoi ce projet a été critiqué

L’autorité britannique (ICO) a identifié plusieurs manquements :

- absence de base légale claire

- manque d’information des patients

- volume de données disproportionné

- non-respect du principe de minimisation

→ En résumé :

trop de données ont été partagées, sans justification suffisante.

Ce que ce cas révèle

Il ne s’agissait pas d’un piratage.

→ Le problème était la gouvernance des données :

- quelles données sont utilisées

- pourquoi

- en quelle quantité

- avec quels acteurs

Projet IA et RGPD : le vrai risque pour les entreprises

Dans de nombreux projets IA, le danger ne vient pas d’une attaque externe.

→ Il vient :

- d’un partage mal contrôlé avec un prestataire

- d’un dataset mal préparé

- d’une mauvaise identification des données sensibles

Un projet peut donc devenir :

→ un risque réglementaire majeur sans aucune fuite de données

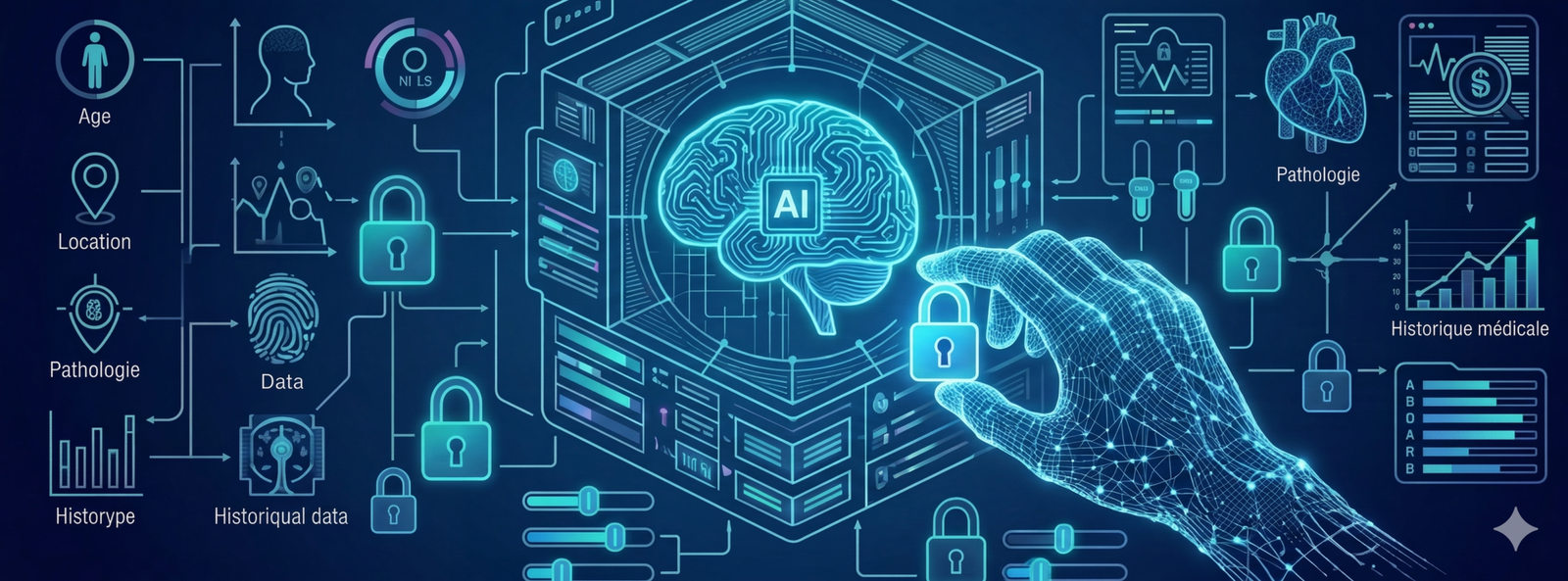

Le risque invisible : la corrélation des données

Un dataset utilisé pour l’intelligence artificielle peut contenir :

- âge précis

- pathologie rare

- localisation

- date d’intervention

- historique médical

Pris isolément, ces éléments peuvent sembler anodins.

Mais combinés, ils peuvent permettre d’identifier une personne.

→ Le risque ne provient pas d’un seul champ

→ Il apparaît à travers les corrélations entre plusieurs informations

Comment rendre un projet IA conforme au RGPD

Avant de lancer un projet impliquant des données sensibles, plusieurs étapes sont essentielles :

- Détecter les données sensibles

→ identification automatique des colonnes à risque - Minimiser les données

→ ne conserver que le strict nécessaire - Réduire la granularité

→ regrouper ou simplifier certaines informations - Anonymiser lorsque possible

→ supprimer toute possibilité de ré-identification - Documenter les décisions

→ DPIA, choix techniques, gouvernance

→C’est précisément ces étapes que nous mettons en œuvre chez Nymdata.

Ce que les autorités de contrôle analysent

Lorsqu’une autorité examine un projet IA, elle analyse notamment :

- la documentation du projet

- l’analyse d’impact (DPIA)

- la proportionnalité du traitement

- les mesures techniques de protection

- la gouvernance globale des données

→ Pas seulement la sécurité.

La vraie question stratégique

La question n’est pas seulement :

→ Où sont stockées les données ?

Mais :

→ Ces données sont-elles nécessaires, maîtrisées et correctement préparées ?

Conclusion

Le cas NHS / DeepMind n’était pas un piratage.

C’était un problème de gouvernance des données.

Dans les projets d’intelligence artificielle, tout se joue avant l’entraînement du modèle :

- détecter

- minimiser

- anonymiser

- documenter

→ C’est cette approche qui permet de concilier :

- innovation technologique

- conformité RGPD

- confiance

Vous pouvez également retrouver notre article qui explique en détails pourquoi le chiffrement seul ne suffit plus

FAQ

Un projet IA est-il soumis au RGPD ?

Oui, dès lors qu’il traite des données personnelles, y compris en phase de test.

La pseudonymisation suffit-elle ?

Non, les données restent personnelles si une ré-identification est possible.

Pourquoi l’IA augmente les risques ?

Plus de données, plus de croisements, plus d’exposition.

Première étape ?

Identifier précisément les données sensibles.